Guía técnica sobre metodologías de validación de experimentos web que trascienden el valor p, optimizando la toma de decisiones basada en el impacto económico y la certidumbre probabilística.

Índice de Contenidos

¿Por qué la Significancia Estadística ya no es suficiente?

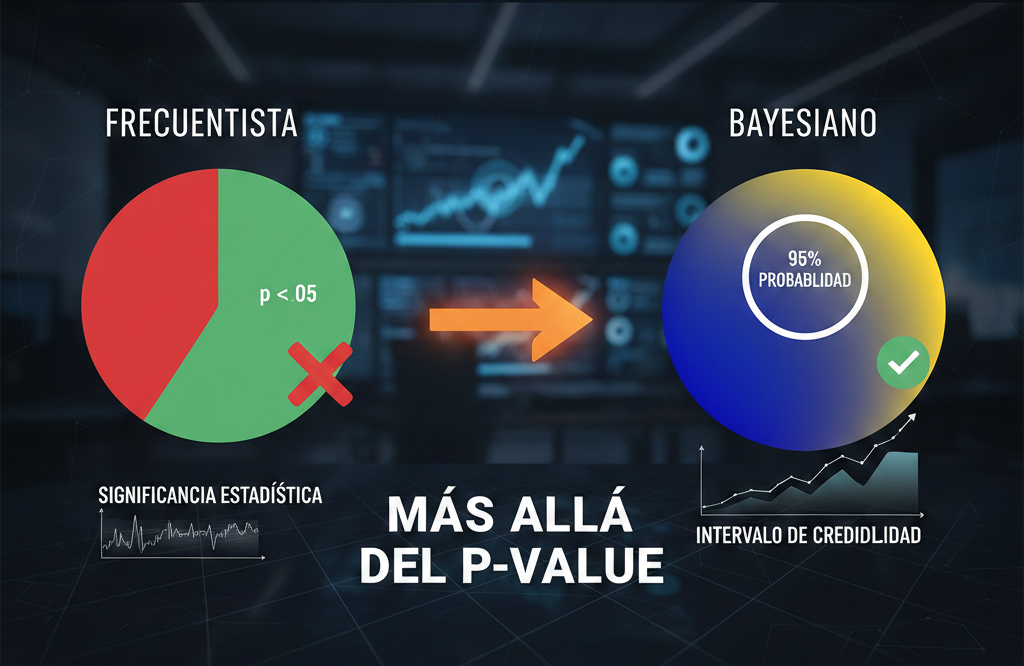

En el CRO moderno, el valor p suele ser malinterpretado como una medida de la magnitud de la victoria, cuando en realidad solo indica la probabilidad de que los datos observados ocurran bajo la hipótesis nula. Un test puede ser «significativo» y, sin embargo, ser económicamente irrelevante.

Para validar una mejora de forma robusta, debemos pasar de una validación dicotómica (éxito/error) a una validación de valor, donde la incertidumbre y el tamaño del efecto dictan la implementación técnica.

Estrategias de Validación: Más allá de la Campana de Gauss

Para confirmar que una variante merece ser desplegada a producción, es imperativo analizar estos tres pilares complementarios:

1. Significancia Práctica y Tamaño del Efecto

La significancia estadística depende del tamaño de la muestra; con suficiente tráfico, cualquier cambio mínimo será «significativo». La Significancia Práctica exige que el lift supere un umbral mínimo de rentabilidad (MDE). Si el incremento no cubre los costes de mantenimiento del nuevo código, el test es un fallo de negocio.

2. Inferencia Bayesiana: Probabilidad de Ser Mejor

A diferencia del enfoque tradicional, el análisis Bayesiano nos permite afirmar: «Hay un 95% de probabilidad de que la Variante B sea mejor que la A». Esto elimina la rigidez de los periodos de prueba fijos y permite calcular el Riesgo de Pérdida Esperada, una métrica vital para la gestión de presupuestos. Puedes realizar este análisis avanzado de forma automática utilizando nuestra calculadora bayesiana de test A/B para obtener una visión completa del impacto económico de tu experimento.

3. Estabilidad Temporal y Análisis de Segmentos

Un ganador real no fluctúa. Validar la mejora requiere observar el Cumulative Lift para descartar el «efecto novedad». Además, la validación por segmentos (dispositivo, fuente de tráfico) asegura que la ganancia es estructural y no un outlier provocado por una campaña de marketing puntual.

Optimización de la Validación: Tabla Comparativa

Seleccionar el método de validación depende de la tolerancia al riesgo de la organización y el volumen de datos disponible:

| Criterio de Validación | Ventaja Competitiva |

|---|---|

| Intervalos de Confianza | Proporciona el rango de ganancia mínima y máxima esperada. |

| Factor de Bayes | Cuantifica cuánta evidencia tenemos a favor de la variante. |

| Métricas de Salud (Counter-metrics) | Asegura que la mejora en un KPI no canibalice otra métrica crítica. |

| Análisis de Persistencia | Valida si el comportamiento se mantiene tras 14 o 21 días. |

Workflow: Del Resultado a la Implementación

El proceso de validación técnica para confirmar una variante ganadora debe seguir estos pasos iterativos:

- Auditoría de Datos: Descartar telemetría corrupta o interferencias de bots.

- Cálculo de la Magnitud: ¿El incremento observado justifica el cambio de infraestructura?

- Test de Probabilidad: Aplicar modelos Bayesianos para entender el riesgo de error.

- Análisis de Micro-conversiones: Confirmar que el flujo del usuario es coherente con la mejora.

- Decisión de Roll-out: Implementación gradual (25%, 50%, 100%) para monitorizar estabilidad.

Reporting Avanzado: Comunicando Certeza

Para que la validación sea aceptada por los niveles ejecutivos, el lenguaje debe mutar de la estadística a la economía:

El Párrafo de Definición de Éxito

La variante B ha validado una mejora incremental del 4.2% con un nivel de credibilidad del 97%. A diferencia de los modelos estándar, esta validación considera la estabilidad de la cohorte y garantiza que el impacto en el margen neto sea positivo tras deducir costes operativos.

Entidades Semánticas de Validación

Es fundamental integrar conceptos como «Distribución Posterior», «Intervalo de Credibilidad», «Error Tipo II» y «Pérdida Esperada» para fortalecer la autoridad técnica del análisis.

«No buscamos la verdad estadística absoluta, buscamos la reducción de la incertidumbre necesaria para tomar una decisión comercial rentable.»

— CXL Institute

Riesgos y Desafíos de la Validación Alternativa

Ignorar la estadística tradicional sin rigor puede llevar a conclusiones peligrosas. Estos son los principales escollos:

1. El Sesgo de Parada Temprana

En modelos no Bayesianos, mirar los resultados antes de tiempo («peeking») aumenta drásticamente la tasa de falsos positivos. La validación solo es real si se respeta el tamaño de muestra precalculado.

2. La Regresión a la Media

Muchas variantes que parecen ganadoras en los primeros tres días terminan igualándose al control. La validación requiere al menos un ciclo completo de compra (usualmente 7 días) para ser considerada legítima.

Preguntas Frecuentes sobre Validación de Experimentos A/B

¿Qué es el Intervalo de Credibilidad y por qué es superior al de Confianza?

En el enfoque frecuentista, el intervalo de confianza te dice que, si repitiéramos el test infinitas veces, el 95% de esos intervalos contendrían el valor real. Es una métrica de proceso, no de resultado.

El Intervalo de Credibilidad (Bayesiano), en cambio, te permite afirmar: «Hay un 95% de probabilidad de que el incremento real esté entre el 2% y el 5%». Es mucho más intuitivo para la toma de decisiones empresariales porque habla de probabilidades reales sobre el test actual.

¿Cómo se define un MDE (Efecto Mínimo Detectable) rentable?

El MDE no es solo un parámetro estadístico, es una decisión financiera. Para definirlo, debes calcular el coste de oportunidad de implementar la variante: tiempo de desarrollo, mantenimiento de código y riesgos operativos.

Si el coste de implementación requiere un aumento del 1% en la conversión para ser rentable, tu MDE debería ser de al menos el 1.2% o 1.5% para garantizar un margen de seguridad.

¿Qué es el «Factor de Bayes» y cómo ayuda a cerrar tests antes de tiempo?

El Factor de Bayes cuantifica la fuerza de la evidencia que los datos proporcionan para una hipótesis frente a otra. A diferencia del valor p, el Factor de Bayes puede decirte cuándo hay suficiente evidencia para confirmar que no hay diferencia entre las variantes.

Esto permite aplicar el Early Stopping (parada temprana) de forma segura, ahorrando semanas de tráfico en tests que no van a ninguna parte o que ya han demostrado una victoria clara.

¿Por qué el «Lift» inicial de un test suele desinflarse con el tiempo?

Este fenómeno se conoce como Efecto de Novedad o Regresión a la Media. Los usuarios recurrentes suelen reaccionar a cualquier cambio visual simplemente por ser nuevo, lo que infla artificialmente la conversión los primeros días.

Para una validación real, se recomienda ignorar los primeros 3-5 días de datos y centrarse en la estabilidad del lift durante al menos dos ciclos comerciales completos (generalmente 14 días).

¿Cómo influye la Carga Cognitiva en la validación de una variante?

A veces, una variante aumenta la conversión pero incrementa la Carga Cognitiva (esfuerzo mental). Esto puede generar un «pico» de ventas a corto plazo pero dañar la retención o aumentar las devoluciones si el usuario se siente confundido o manipulado por patrones oscuros.

Validar la mejora requiere mirar métricas de salud como el NPS post-compra o la tasa de contacto a soporte técnico.

¿Qué riesgos tiene la segmentación post-hoc en la validación?

La segmentación post-hoc (mirar los datos por navegador o país después de que el test termine) es peligrosa debido al Problema de las Comparaciones Múltiples. Si torturas los datos lo suficiente, siempre encontrarás un segmento donde la variante «ganó» por puro azar.

La validación por segmentos solo es legítima si se planteó como una hipótesis a priori o si el tamaño de la muestra en ese segmento es lo suficientemente grande para mantener la potencia estadística.

¿Cuándo es aceptable implementar una variante con significancia estadística pero sin ROI positivo?

Solo en dos escenarios: 1. Mejora de Marca/UX: Cambios que alinean la web con la nueva identidad visual sin dañar la conversión. 2. Simplificación Técnica: Cuando la nueva variante reduce la deuda técnica o mejora la velocidad de carga, incluso si la conversión se mantiene plana (test de paridad).

Conclusión

Validar la mejora de un test A/B requiere un equilibrio entre rigor matemático y visión de negocio. Utilizar la significancia práctica y la probabilidad Bayesiana permite a los equipos de producto moverse más rápido y con mayor seguridad financiera.

¿Deseas calcular la significancia estadísitica de un test A/B? Ir a calculadora de significancia estadística.

Deja una respuesta